Como a nova funcionalidade de auto-healing e checkpoints automatizados no Amazon SageMaker HyperPod está salvando semanas de computação e milhões de dólares em clusters de GPUs de larga escala.

A Matemática Implacável da Falha de Hardware

Treinar um Large Language Model (LLM) de ponta em 2026 não é um projeto de software comum; é uma operação de supercomputação industrial. Modelos com trilhões de parâmetros exigem clusters massivos rodando milhares de GPUs simultaneamente (como as instâncias P5 ou as mais recentes P6 baseadas em aceleradores AWS Trainium2) durante meses ininterruptos.

Nesta escala, a falha de hardware deixa de ser uma “possibilidade” para se tornar uma “certeza estatística”. O Mean Time Between Failures (MTBF) de um cluster com 4.000 GPUs indica que, em média, um nó falhará a cada poucos dias. Em arquiteturas tradicionais baseadas em Kubernetes padrão ou Slurm autogerenciado, a queda de um único nó paralisa todo o job de treinamento distribuído. A equipe de MLOps é forçada a intervir manualmente, substituir a instância corrompida, restaurar o último checkpoint e reiniciar o cluster. Esse processo pode levar horas — e quando você está pagando dezenas de milhares de dólares por hora em computação de GPU, esse tempo de inatividade destrói o orçamento do projeto (FinOps).

Para resolver essa dor bilionária do mercado, a AWS amadureceu o Amazon SageMaker HyperPod. Esta infraestrutura construída especificamente para IA Generativa abstrai o gerenciamento de falhas, entregando uma resiliência inédita.

O Fim da Intervenção Humana: Auto-Healing Inteligente

A característica mais transformadora do SageMaker HyperPod é o seu sistema de Auto-Healing (auto-recuperação) nativo. O HyperPod monitora ativamente a integridade da frota em múltiplos níveis: desde a verificação de conectividade da rede até anomalias profundas no silício (como erros de memória ECC nas GPUs ou falhas nos links NVLink).

Quando uma degradação é detectada, a reação do HyperPod é determinística e automatizada:

- O nó defeituoso é imediatamente isolado para não corromper os gradientes de treinamento.

- O HyperPod provisiona automaticamente uma nova instância EC2 do mesmo tipo nos bastidores.

- O cluster é reconfigurado de forma dinâmica.

- O job de treinamento é reiniciado de forma autônoma a partir do último checkpoint salvo.

Tudo isso acontece sem que o Engenheiro de Machine Learning precise abrir um chamado ou rodar um script de terraform. A economia de horas de ociosidade das GPUs saudáveis justifica o uso da plataforma já na primeira falha detectada.

Checkpointing Otimizado com Amazon FSx for Lustre

Para que a auto-recuperação seja eficiente, a operação de salvar e restaurar o estado do modelo (checkpointing) deve ser quase instantânea. Salvar os pesos de um modelo de 1 trilhão de parâmetros gera arquivos que ultrapassam a marca dos Terabytes. Fazer o upload disso para o Amazon S3 padrão a cada 2 horas criaria um gargalo de I/O massivo, pausando o treinamento e desperdiçando ciclos de GPU.

O HyperPod resolve isso integrando-se nativamente ao Amazon FSx for Lustre. Este sistema de arquivos paralelo de altíssima performance entrega latências de sub-milissegundos e taxa de transferência (throughput) na casa dos centenas de Gigabytes por segundo. O cluster salva o checkpoint na memória flash do FSx em segundos, e o FSx sincroniza esse estado de forma assíncrona para um bucket S3 durável em segundo plano, mantendo as GPUs trabalhando a 100% de utilização.

Redes Avançadas: Elastic Fabric Adapter (EFA)

A velocidade de um cluster de IA é ditada pelo seu elo mais lento. No treinamento distribuído moderno (usando bibliotecas como NVIDIA NCCL ou o AWS Trainium Neuron SDK), os nós precisam trocar gradientes matemáticos uns com os outros constantemente (operações de AllReduce).

O SageMaker HyperPod pré-configura toda a topologia de rede utilizando o Elastic Fabric Adapter (EFA) da AWS. Ao desviar o tráfego do kernel do sistema operacional (OS bypass) e usar o protocolo SRD (Scalable Reliable Datagram), o HyperPod garante uma comunicação com micro-segundos de latência. O orquestrador posiciona as instâncias nas mesmas “folhas” de rede (Spine-Leaf architecture) dentro do data center da AWS para minimizar os saltos dos pacotes de dados.

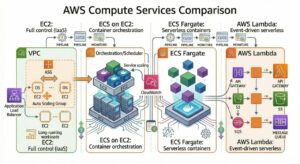

Flexibilidade do Orquestrador: Slurm ou EKS

O mercado de IA é altamente opinativo. Algumas equipes acadêmicas e de pesquisa preferem o orquestrador Slurm tradicional, enquanto empresas focadas em engenharia de software preferem o Amazon EKS (Kubernetes). O HyperPod de 2026 abraça ambas as filosofias. Ele atua como uma camada de infraestrutura resiliente que roda por baixo do seu orquestrador favorito. Se você usa o EKS, o HyperPod injeta os controllers necessários para garantir que os pods de treinamento não fiquem órfãos se a máquina física morrer, integrando perfeitamente a resiliência de hardware com a orquestração de containers.

Conclusão

Treinar modelos fundacionais deixou de ser um desafio puramente algorítmico para se tornar um desafio extremo de engenharia de infraestrutura. Construir scripts próprios para lidar com falhas de rede, kernel panics e gargalos de armazenamento não traz diferencial competitivo para a sua empresa; apenas drena a energia dos seus cientistas de dados. O Amazon SageMaker HyperPod automatiza o “trabalho pesado e indiferenciado” da supercomputação, permitindo que a sua equipe foque no que realmente importa: a qualidade dos dados, a arquitetura da rede neural e a velocidade do Time-to-Market.

Sobre a KXC Partner

A KXC Partner apoia empresas na evolução de sua maturidade em nuvem, com foco em governança, otimização de custos, segurança e automação.

Acompanhe nosso blog para mais conteúdos técnicos e estratégicos sobre AWS e transformação digital.