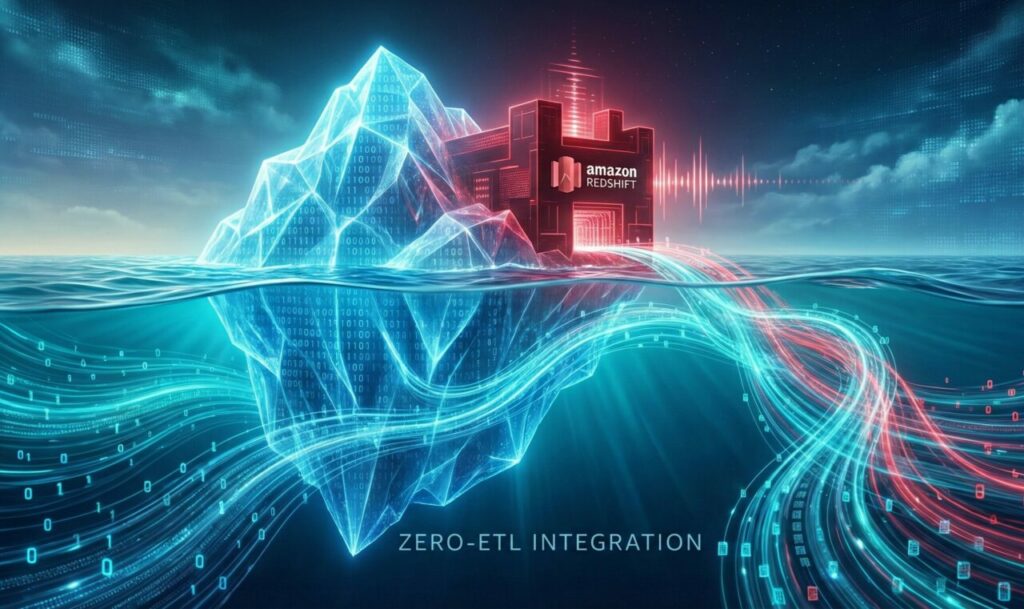

Amazon Redshift com tabelas Apache Iceberg. A morte das pipelines complexas: Unificando Data Lakes e Data Warehouses com performance de petabytes.

Introdução

Há dois anos, “Zero-ETL” era apenas uma buzzword de marketing promissora. Hoje, em 2026, tornou-se um requisito de arquitetura. A era de mover, copiar e transformar dados freneticamente entre o S3 e o Data Warehouse acabou. Com a maturação da integração nativa do Amazon Redshift com tabelas Apache Iceberg, as empresas estão finalmente desmontando as pipelines frágeis que consumiam 40% do tempo de suas equipas de engenharia.

Neste artigo, analisamos por que essa arquitetura híbrida se tornou o padrão ouro para Big Data, explorando desde os fundamentos técnicos até os impactos financeiros mensuráveis que estão transformando a forma como as organizações lidam com analytics em escala de petabytes.

O Fim da Duplicidade de Dados

O modelo tradicional obrigava as empresas a manterem duas cópias da verdade: uma “crua” e barata no Data Lake (S3) e uma “curada” e cara no Data Warehouse. Isso gerava latência na disponibilidade da informação, custos dobrados de armazenamento e, pior ainda, inconsistências frequentes entre as duas fontes.

A integração atual do Redshift com Iceberg permite que o Warehouse atue como uma camada de computação pura, eliminando a necessidade de ETL tradicional. Ele lê os metadados do Iceberg diretamente no S3 com uma performance assustadoramente próxima (cerca de 95%) das tabelas nativas armazenadas em discos SSD gerenciados pelo Redshift.

O segredo está na arquitetura de metadados do Iceberg: ao invés de escanear arquivos Parquet inteiros, o Redshift consulta apenas os manifestos necessários, aplicando partition pruning e predicate pushdown antes mesmo de tocar nos dados. Isso significa que queries complexas com filtros por data ou região podem ignorar 99% dos arquivos no S3, mantendo latências na casa dos segundos mesmo em datasets de múltiplos petabytes.

Por que Apache Iceberg?

A AWS apostou corretamente ao não forçar um formato proprietário. O Apache Iceberg venceu a “guerra dos formatos” (contra Hudi e Delta Lake) em grandes corporações devido à sua gestão agnóstica de metadados, suporte robusto a schema evolution e capacidade de time travel nativa.

Em 2026, a capacidade do Redshift de ler transações ACID do Iceberg em tempo real significa que um engenheiro de dados pode fazer um UPDATE ou DELETE massivo via Spark/EMR no S3, e o analista de negócios vê o reflexo disso no painel do QuickSight milissegundos depois, sem precisar rodar um comando VACUUM ou recarregar tabelas.

Além disso, o Iceberg oferece recursos avançados como hidden partitioning (onde você particiona por mês mas consulta por dia sem reescrever queries), snapshot isolation para leituras consistentes mesmo durante escritas simultâneas, e compaction automático que mantém a performance estável ao longo do tempo. Essas capacidades eliminam classes inteiras de jobs de manutenção que antes consumiam recursos preciosos das equipas de engenharia.

Habilitando o Data Mesh Real

A maior barreira para o Data Mesh sempre foi a interoperabilidade entre domínios. Com esta arquitetura, o domínio de “Vendas” pode produzir seus dados em Iceberg usando as ferramentas que preferir (Glue, EMR, Flink, ou até mesmo Kafka com Iceberg sink connectors), e o domínio de “Marketing” pode consumi-los via Redshift Serverless sem pedir permissão ou construir pipelines de ingestão dedicadas.

O dado vive no S3, é governado centralmente pelo AWS Lake Formation (com políticas granulares de acesso a nível de coluna e linha), e é consultado pelo Redshift com a mesma facilidade de tabelas locais. Desacoplar o armazenamento da computação nunca foi tão real.

Esta arquitetura também facilita a implementação de data contracts: cada domínio publica schemas versionados no Glue Data Catalog, consumidores subscrevem aos datasets relevantes, e breaking changes são detectados automaticamente antes de quebrar dashboards em produção. O resultado é uma malha de dados verdadeiramente federada onde a governança não sacrifica a agilidade.

TCO e Estratégia Financeira

Para CTOs, a matemática é simples: armazenar Petabytes no S3 Standard custa aproximadamente $23 por TB/mês, enquanto nós RA3 do Redshift custam facilmente 10x mais quando consideramos compute e storage. Ao manter o dado histórico (“frio” ou “morno”) em Iceberg e usar o Redshift apenas para queries quentes e complexas, as empresas estão reduzindo a fatura de Analytics em até 30-40%.

Você paga pelo poder de processamento quando precisa, não pelo “estacionamento” de dados que raramente acessa. Melhor ainda: com Redshift Serverless, você elimina a necessidade de provisionar clusters fixos, pagando apenas pelos RPUs (Redshift Processing Units) consumidos durante as queries. Para workloads com picos variáveis, isso pode representar economias adicionais de 50-70% comparado a clusters sempre ligados.

Outro benefício oculto: ao reduzir pipelines ETL complexas, você diminui a superfície de ataque para falhas. Menos código significa menos bugs, menos monitoramento necessário e equipes mais focadas em gerar valor analítico ao invés de “manter as luzes acesas” da infraestrutura de dados.

Conclusão

Se a sua equipa ainda está escrevendo scripts Python complexos, jobs do Glue intermináveis ou workflows do Airflow apenas para copiar dados do S3 para dentro do Redshift, pare imediatamente. Você está resolvendo um problema que a arquitetura moderna já resolveu nativamente, desperdiçando tempo valioso de engenharia que poderia estar sendo investido em features que realmente diferenciam o seu negócio.

A estratégia vencedora para 2026 é cristalina: armazene em formatos abertos e interoperáveis (Iceberg, Parquet), processe com motores elásticos que escalam sob demanda (Redshift Serverless, EMR Serverless, Athena), e elimine o ETL onde ele não agrega valor de negócio tangível. A era do “unified analytics” não é mais futuro — é presente, e quem não se adaptar estará competindo com uma mão atada nas costas.

Essa abordagem faz parte das soluções de automação na AWS oferecidas pela KXC Partner.